ComfyUIは、生成AIの処理をノードでつないでワークフロー化できるツールです。

画像や動画が話題ですが、音楽生成モデルACE-StepもComfyUIで扱いやすくなりました。

以前は導入は手作業が必要でしたが、UIからテンプレートを読み込んでプロンプトを入れるだけで曲が生成できます。

本記事では将来的な曲生成の自動化まで含め、シリーズで試していきたいと思います。

ACE-Stepとは:楽曲をローカルで生成できる無料AIモデル

「ACE-Step」は、テキスト(曲調のタグや歌詞)から音楽を生成するオープンソースのAIモデルです。

以前はACE-Stepのインストールは手動で行う必要があり、gitリポジトリやPythonの知識が必要で、気軽な音楽生成というにはハードルが高いものでした。

ComfyがACE-Stepにネイティブで対応したことで、拡張機能マネージャーからワンクリックでインストール可能となり身近なものとなりました。

ComfyUI側では、公式ドキュメントのACE-Stepチュートリアルに沿った「ネイティブ例(テンプレート/例ワークフロー)」をベースに進めます。

ComfyUI ACE-Step Native Example – ComfyUI

まずは公式例どおりに動かし、必要に応じて拡張ノード(Custom Nodes)に進んでみましょう。

ace-step/ACE-Step: ACE-Step: A Step Towards Music Generation Foundation Model

ComfyUIを用意する:ComfyUI Desktopがおすすめ

ComfyUIは複数の配布形態がありますが、初めてなら公式ドキュメントのインストール案内に従うのが確実です。

ComfyUI Official Documentation – ComfyUI

Windows/Mac/Linuxとも「ComfyUI Desktop」が利用可能で、依存関係をまとめて整えたい人には便利です。

本連載では、ACES-Stepで生成した音楽を素材とした動画生成やYouTube投稿までを視野に入れています。Stability MatrixのComfyUI環境を利用すると、画像生成や動画生成も一括で扱えるためおすすめです。

ACE-Stepの例:テンプレートで簡単に曲を生成

ComfyUIには、ACE-Stepを使うための公式チュートリアルが用意されています。

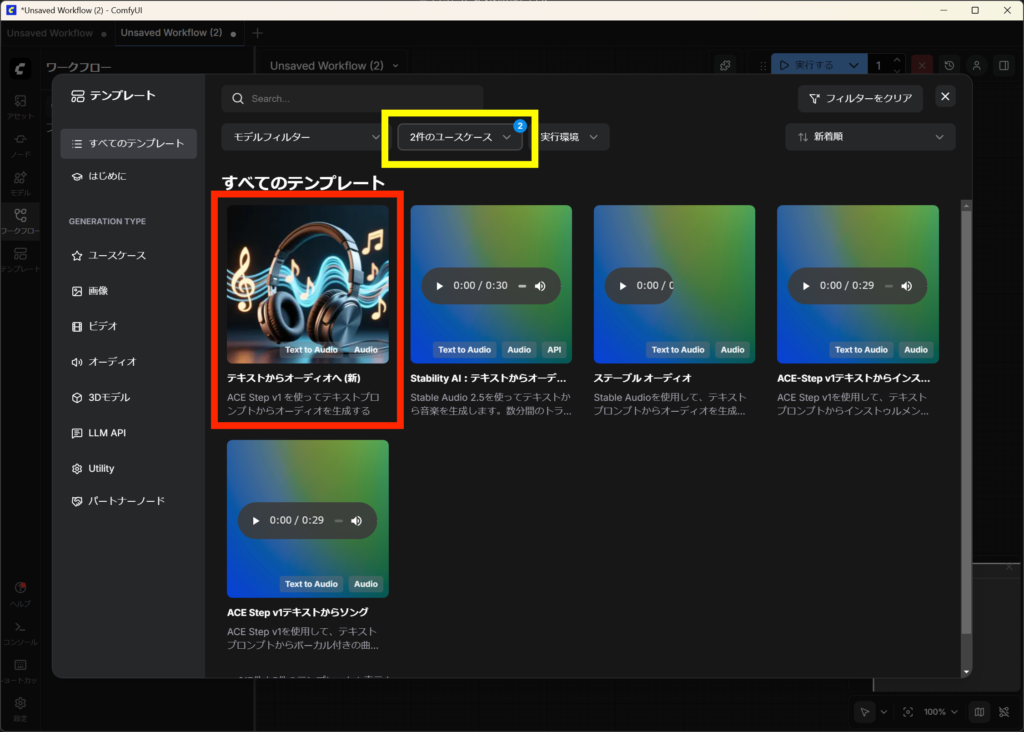

また、ComfyUIからACE-Stepを利用するテンプレートがいくつか公開されています。ComfyUIのテンプレート選択画面で”Text to Audio”等で検索すると出てきます。

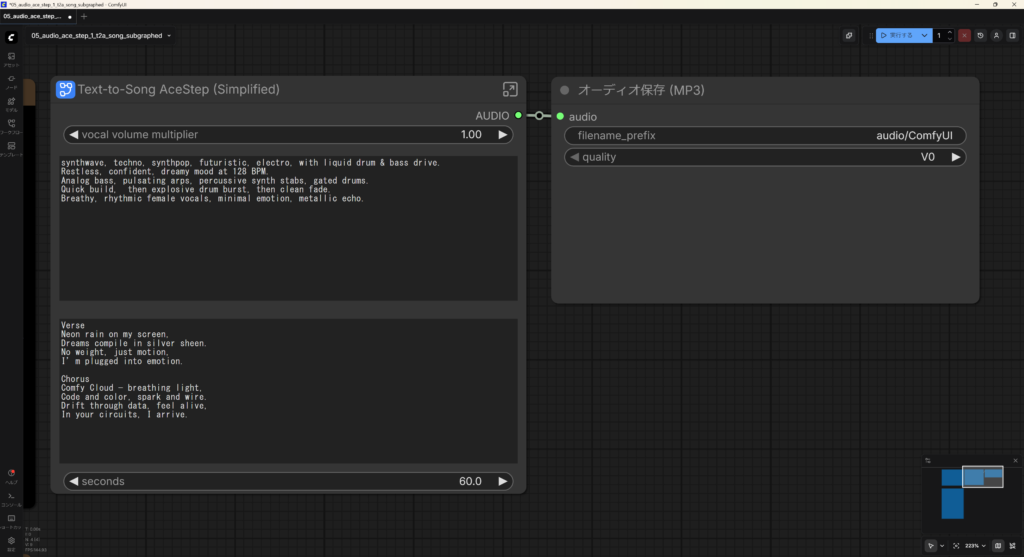

いくつかバージョンがありますが、ここでは「テキストからオーディオへ(新)」を試しています。

Stable Audioのテンプレートも見つかりますが、現状はText to Audioに対応するモデルの数は少ないので迷うことは少ないでしょう。

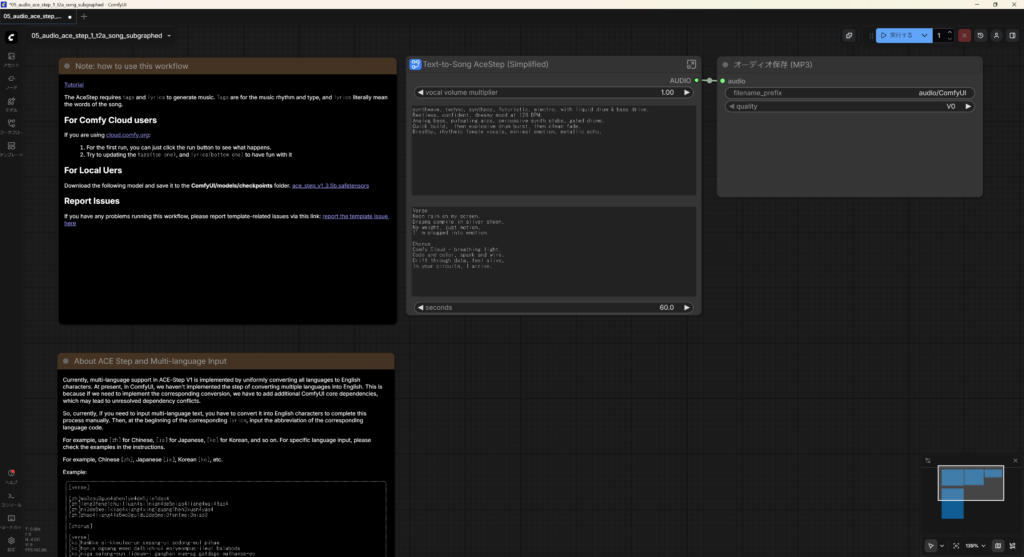

テンプレートを開いた後、予め例文で入力されたプロンプトを適宜書き換え、生成ボタンを押すだけで音楽が生成されます。

左の縦2つのノードは説明です。英語ですが一読しておくと良いでしょう。

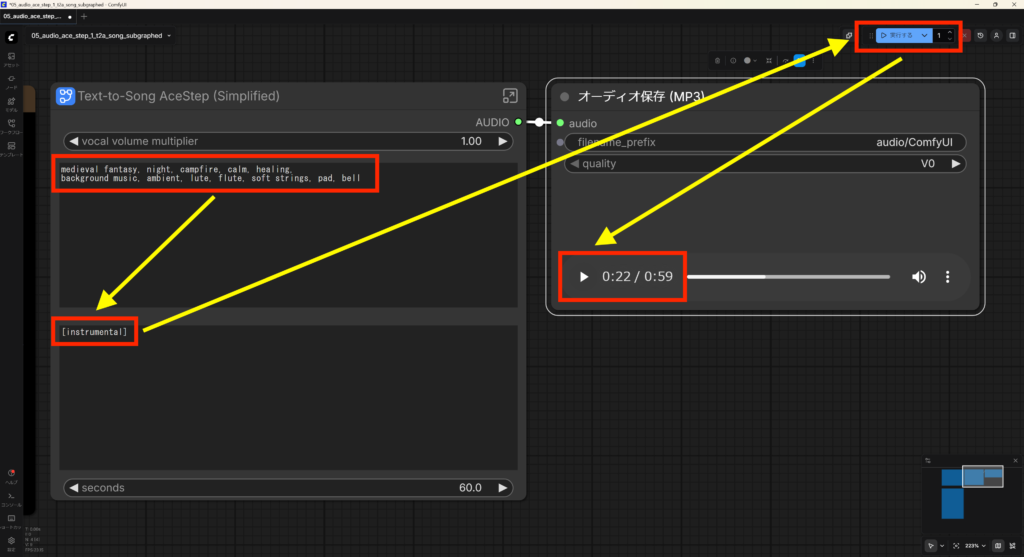

まずはこの例をそのまま読み込み、動く状態を作ります。ワークフローが完走すると、プレビューと保存を担うノード(Save Audio)で再生でき、ファイルも保存されます。

プロンプトの基本

Text-toSong AceStep (Simplified) に2つ入力欄があります。 上がいわゆるプロンプトで、下の欄には歌詞を入れます。

プロンプト欄には、ACE-Stepでは、曲調を表すタグ(style/tags)と、歌詞(lyrics)を組み合わせて指定します。 タグは「ジャンル+雰囲気+楽器」くらいの粒度で、欲しい方向を2〜3語で固定して試すのがおすすめです。

歌詞の欄には[instrumental]と入れた場合はインストゥルメンタル曲が生成され、短いフレーズを入れた場合は歌入りの曲が生成されます。 日本語の歌詞も利用可能ですが、プロンプト自体は英語で書く必要があります。

インストゥルメンタルにしたい場合は、歌詞欄に [instrumental] を入れます。

公式チュートリアルでは、タグの例として male voice を female voice に変える、といった例も紹介されています。

デフォルトの設定では1分の長さのmp3ファイルが生成されます。

まずは生成された曲を聞き、ACE-Stepでできることを把握しておくのがおすすめです。

まとめ

今回はComyfyUIでACE-Stepを利用し、音楽を生成するまでを試しました。

以前は導入に1時間程度かかっていたことを考えると、驚異的な進歩です。

いろいろと試したり、バッチ処理を行うにはComfyUIは最適なツールです。

次回はPythonからComfy UIをAPIで呼び出す方法を試し、音楽生成の自動化を試します。