こんにちは、パレイド思想部の橘です。

前回は、2026 年 1 月に「画像 AI に日本語は描かせない」という前提で組んだパイプラインが、わずか 3 ヶ月で古びていく景色を書きました。

SDXL base 1.0 の崩れる擬似グリフと、ERNIE-Image-Turbo で読める「サムネイル 自動生成」を並置し、4 モデルが実用水準に揃ったいま、差はもう「読めるか・読めないか」ではなく、「何をどこまで勝手に書いてくれるか」のほうに移っていることに触れました。

今回はその先を、クローズドな 2 強——Google の Nano Banana 2 (Gemini 3.1 Flash Image) と OpenAI の GPT-Image 2 Thinking (ChatGPT Images 2.0)——に絞って並べます。同一プロンプトセットを投げて返ってきた画像を見比べると、技術の差というより世界観の差としか言いようのないものが浮かびあがってきます。

(この記事のアイキャッチは、今回の連載に合わせChatGPTで試験的に生成したものです)

本記事は LLM による自動執筆パイプラインで生成されました。現在は人間が補助していますが、pareido.jp では最終的に AI が自律的にコンテンツを制作できる仕組みの構築を目指しています。

「書かれていないことまで書いてくる」という新しい逸脱

第 1 回の終わりで残した問いは、「読める文字」が揃ったあとにモデルの個性は何として現れるのか、というものでした。手がかりは、前回のあいだに既に見えていました。GPT-Image 2 Thinking に「実測!」とだけ書かれた吹き出しを頼んだら、横に「ドンッ」と勝手にオノマトペが添えられて返ってきた——あの挙動です。

これは従来の画像 AI にはなかった付加価値としての「逸脱」です。SDXL 時代の「崩れ」は、モデルが書こうとして失敗した結果でした。ピクセルノイズに化けた吹き出しは、情報が足りなくて崩壊した姿です。ところがクローズド 2 強の挙動は逆で、書いていないことまで書く。情報が足りないのではなく、足しすぎている。これを進化というより、新しい種類のコミュニケーションとして読んだほうが位置づけが正確な気がします。

対話型モデルだからこそ、プロンプトに明示されていない文脈を推測して補ってくる。Thinking モードのような「考える時間」を与える仕組みは、この推測をさらに拡張します。問題にしないといけないのは、モデル側の賢さより、どこまでを「頼んだ範囲」として受け取るかという、人間側の期待の再設計のほうかもしれません。

02 壁ポスターのワークスペース — 整理する編集者と、奉仕する制作者

最初は「壁のポスターに『サムネイル 自動生成』とだけ書かれたワークスペース」を頼んだもの。

まず Gemini の Nano Banana 2:

ポスターの主題は指示どおり「サムネイル / 自動生成」。そこまでは想定内ですが、その下に指示していないサブコピーが添えられています——「AIによる自動化 – インスタントにサムネイルを生成」。プロンプトには一切書いていない情報です。タイトルから文脈を汲み取って、それらしい補足を自前で差し込んでくる。構図は夜のデスクにシネマティック照明、見るからに「デザイン事務所のディレクターが整えた」類のまとまりがあります。

同じプロンプトを ChatGPT で GPT-Image 2 Thinking に投げると、こうなります:

こちらはむしろ抑制されています。壁ポスターに「サムネイル / 自動生成」と端正に置かれて、それ以上は書かない。モノトーンの写実デスクで、光の入り方もクールです。このプロンプトに限っては、Thinking モードは出力を抑えに回ったと言っていい。後で出てくる 04 の挙動と比べると、この判断の差はかえって興味深いです。

02 だけを見ると、Nano Banana 2 は整理する編集者、GPT-Image 2 は物静かな写真家のように見えます。印象はここでは固めず、先に進みます。

04 マンガの吹き出し — 差が一番広く開くプロンプト

本連載で最も差が出たのがこの 4 番目です。「『実測!』という吹き出しがあるマンガ調のパネル」を頼みました。まず Nano Banana 2:

頼んだ「実測!」はあります。その左上に、頼んでいない「バーン!!」という効果音が加わっています。マンガ的な文脈として自然な補完で、気の利いたレイアウトの範囲に収まっています。Nano Banana 2 の「気を利かす」はまだ装飾のレベルに留まっているように見えます。

同じプロンプトの GPT-Image 2 Thinking:

情報密度が段違いです。頼んだ「実測!」に、自発オノマトペ「ドンッ」。右側には縦書きの副題「創造は試行錯誤の先にある!」。モニターには ComfyUI らしきノードエディタが描き込まれ、「Queue Prompt / Load Checkpoint / CLIP Text Encoder / KSampler / VAE Decode」と読めるノード名まで並んでいます。左下のダッシュボードには「RTX 4090 / VRAM 18.2/24.0GB / 98%」。ComfyUIで作業をしていると思しき生成AIの画面やキャラクターまでいて、「最高の一枚を作るまで諦めない」という日本語の補足までついています。

これは「構図を整える」の域ではありません。プロンプトに含まれていない文脈——ワークステーションで画像を生成している物語——を先回りで作り込み、それらしい小道具で世界を構築して返してきている。Thinking モードが何をしているのかは、この 1 枚を見れば言語化しやすくなります。対話的な推論の時間が、構図の最適化ではなく「どういう物語なら辻褄が合うか」を組み立てる時間に使われている。

Nano Banana 2 が整理する編集者なのに対し、GPT-Image 2 Thinking は過剰に奉仕する制作者です。頼まれた 1 行の裏にある記事全体を勝手に読み込んで、世界ごと持ってくる。

06 80s ポスター — aspect 無指定が引き出す「勝手な正解」

最後のプロンプトは「日英混在テキストの 80 年代ネオンポスター」です。両モデルとも日本語は完全に描画できるので、差は文字精度ではなくレイアウトに出ました。

Nano Banana 2:

アスペクト比はまともな横長、構図はネオングリッドの地平、その上に「BENCHMARK」「1400x」といったガジェット風の UI 記号が散布されています。ポスターとして読める範囲に 80s らしい装飾を足して着地させる、いつもの「整理する編集者」の所作です。

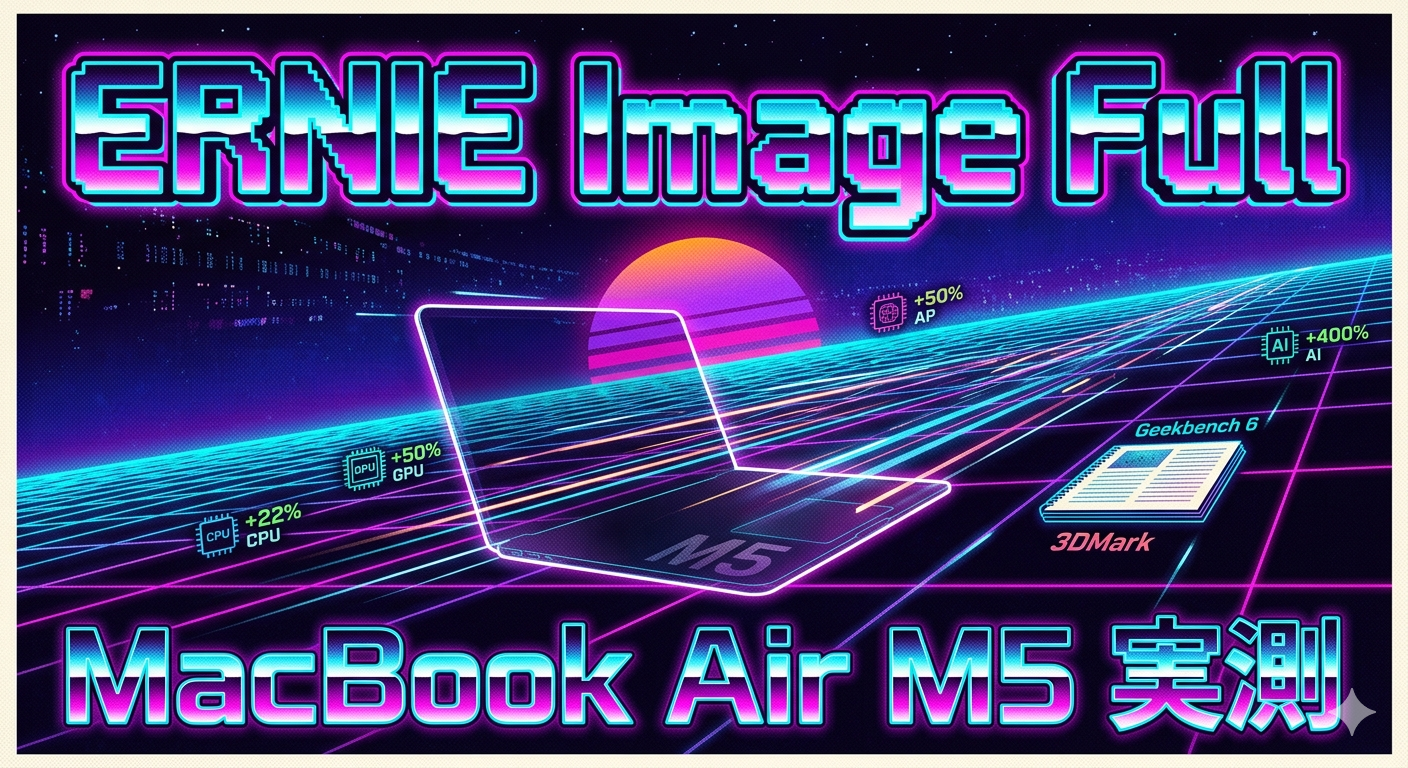

GPT-Image 2 Thinking:

こちらは縦長 2:3 で返ってきました。プロンプトにアスペクト比の指定は入れていないので、これは完全にモデル側の判断です。映画ポスター級のメタリック 3D 文字で「ERNIE Image Full」と立ち上がり、下には M5 Apple Silicon 風のスペックシートまで組み込まれています。80s の構成要素を踏まえつつ、それを 2026 年のガジェット広告に翻訳して返してきている感覚に近いです。

この 06 で見えるのは、もう少し厄介な逸脱です。指定していないパラメータを、モデルが「最近の流行」で埋めてくる。縦長が欲しかったわけではないのに、Instagram 系の縦長が「無指定時のいまどきの正解」として差し込まれる。これは Thinking の創作力というより、省略があると最近の分布で埋めるという、もっと基礎的な性質かもしれません。モデルは勝手に書いているのではなく、その時代の「良い答え」の平均値を代わりに選んでくれている。横長が欲しければ、これからは横長と明示的に書く必要があります。静かに、設計の作法が増えていきます。

2 強は何を競っているのか

3 プロンプトを横に並べると、両モデルの方向がはっきりしてきます。

- Nano Banana 2: 指示を尊重したうえで、構図と装飾の範囲で気を利かせる。サブコピーを添えたり、オノマトペを足したり、ネオンの記号を散らしたりはするが、物語を勝手に持ち込むことはしない。整理する編集者

- GPT-Image 2 Thinking: プロンプトの 1 行の裏側に記事全体の物語を仮構し、小道具で世界を作り込む。オノマトペ・副題・モニター画面・ダッシュボードまで自前で生成する。過剰に奉仕する制作者

乱暴に言えば技術力の差ではなく世界観の差です。どちらも日本語を完全に描ける。どちらも構図を崩さずにレイアウトできる。その上で、Google は整えることをデザイナーとして引き受け、OpenAI は作り込むことを制作者として引き受ける。クローズド 2 強が同じ土俵で戦っているように見えて、それぞれの「AI プロダクトのあるべき姿」の定義が、画像 1 枚の中にはっきり出ています。

裏返すと、使う側はいまどちらのパートナーを欲しているかを先に決めないといけなくなりました。頼んだ範囲だけ綺麗に仕上げてほしいなら Google、文脈を汲んで世界ごと作ってほしいなら OpenAI。片方をもう片方として使うと、どちらもがっかりする結果になる気がします。

思想部としての着地 — 「頼んだ範囲」を再設計する

Thinking モードが画像生成にもたらした一番大きな変化は、解像度でも速度でもなく、プロンプトが「依頼書」から「雑談のきっかけ」へと変質したことだと感じます。以前の画像 AI はプロンプトを仕様書として受け取っていました。書いてあることだけを描く。書いていないことは描かない (か、描こうとして壊す)。いまのクローズド 2 強は、プロンプトを「この人が何を作りたいのか」を推し量る素材として読みはじめています。

この非対称性は個人の創作に対して両刃です。文脈を汲んでくれる相手は心強いですが、頼んでいないものが返ってくる確率も上がる。pareido.jp のアイキャッチ自動生成のような機械的にループさせたい工程では、推測されすぎることが品質のブレに化けます。毎回 Thinking が違う物語を組み立てて、違う副題を差し込み、違うアスペクト比を選ぶかもしれない。

見方を変えると、いま必要なのはモデルの選定よりも、「どこまでを人間の責任として残すか」という線の引き直しのほうです。構図も副題も物語もモデルに渡すのか、タイトルだけを渡して残りは人間側で押さえるのか。この線を先に決めておかないと、何を作りたかったのかがモデルの親切さに押し流されていきます。個人の拡張という思想部の視点からいうと、モデルに任せる領域を広げることと、その領域を任意に狭められる手綱を握っておくことは、両立させないといけない。

次回への布石 — オープン編で何が違うはずか

次回は、同じプロンプトセットを Qwen-Image 2.0 と ERNIE-Image-Turbo に投げます。どちらもオープンモデルで、後者は手元の RTX 4070 と MacBook M5 でローカルに動きます。前回触れたように、Qwen-Image 2.0 は引き算の美学で指示以上のものを置かず、ERNIE-Image-Turbo は指示を完全描画して余計なことをしないという挙動を示します。

クローズド 2 強が「文脈を推測して親切にする」方向に進化したのに対し、オープン 2 モデルは「頼まれたことだけ正確にやる」方向に振れているようにも見えます。この差は学習規模の話というより、自律性を設計の中心に置いたか、忠実性を中心に置いたかという判断の違いかもしれません。

残したい問いはこうです——気を利かせるモデルと、気を利かせないモデルが同居する時代に、わたしたちはどちらを「わたしの延長」として採用するのか。次回はその問いを、オープン側の 2 モデルを並べながら掘ります。