こんにちは、パレイド思想部の橘です。

前回はクローズド 2 強——Google の Nano Banana 2 と OpenAI の GPT-Image 2 Thinking——を並べ、両者の差が技術力ではなく世界観の差であることを書きました。

整理する編集者としての Google、過剰に奉仕する制作者としての OpenAI。そして「気を利かせるモデルと、気を利かせないモデルが同居する時代に、わたしたちはどちらを『わたしの延長』として採用するのか」という問いを残しました。今回はその問いを、別の軸から切り返します。採用できるかどうかの手前に、モデルを手元に置けるか・置けないかという所有関係の話があるはずです。

(この記事のアイキャッチは、今回の連載に合わせERNIE-Imageで試験的に生成したものです)

本記事は LLM による自動執筆パイプラインで生成されました。現在は人間が補助していますが、pareido.jp では最終的に AI が自律的にコンテンツを制作できる仕組みの構築を目指しています。

もうひとつの軸 — 「手元に置けるモデル」

Nano Banana 2 と GPT-Image 2 Thinking は、どちらもクラウドの向こう側で動くモデルでした。問い合わせる先のモデルは、わたしたちの側からは動かすことも直すこともできません。気が利く相手にはありがたみがありますが、明日も同じ挙動をしてくれるかは手の届かないところにあります。

一方、今回扱う 2 モデル——Alibaba の Qwen-Image 2.0 と Baidu の ERNIE-Image-Turbo——は、種類は違えど、手元に寄せられるモデルです。Qwen-Image 2.0 は chat.qwen.ai の無料プランで触れ、DashScope API からも呼べます。ERNIE-Image-Turbo に至っては Apache 2.0 ライセンスで重みそのものが公開されていて、手元の RTX 4070 や MacBook M5 の ComfyUI で動きます。pareido.jp のアイキャッチのように生成を日常的な工程に埋め込む用途では、明日の API 価格や Rate Limit を気にしなくていい再現性が、そのままパイプラインの根を支えます。

この前提で、2 モデルの個性を見ていきます。

Qwen-Image 2.0 — 引き算の誠実さ

まずは chat.qwen.ai の無料プランで Qwen-Image 2.0 に、前回・前々回と同じ 3 プロンプトを投げました。最初は壁ポスターに「サムネイル 自動生成」と書かれたワークスペース。

ポスターの文字は「サムネイル 自動生成」、それだけです。空中に浮いたデュアルディスプレイが前面に出てやや被っています。Nano Banana 2 が自発的に添えたサブコピーも、GPT-Image 2 が作り込むような雰囲気の過剰さはありません。頼んだ文字が頼んだ場所に置かれ、頼んでいないものは置かれない。Qwen-Image 2.0 の最初の印象はこの余計なことをしない誠実さです。

次にマンガ調の吹き出しに「実測!」を入れてもらったもの。

吹き出しの「実測!」、ノードエディタ風の画面、RGB イルミネーションの GPU——マンガ調のパネルとして必要な要素は揃っています。ここには癖も残っていて、青いジャケットの人物像はやや特徴的なテイストの顔立ちに寄っています。開発元が Alibaba で、学習データの分布がそこに現れているのは否定できません。それでも、GPT-Image 2 Thinking のように依頼にない副題や物語を先回りで書き足してくることはない。頼まれた「実測!」と、マンガに必要な小道具まで。そこで手を止めている。

最後に 80s ネオンポスター。

これが 4 モデルの中でもっともミニマルな 06 でした。ネオングリッドの地平、英字の主題、日本語の副題「MacBook Air M5 実測」。余白が広く、情報の密度は意図的に低く抑えられている。GPT-Image 2 が縦長の映画ポスター級に持ち上げ、Nano Banana 2 が横長にガジェット風 UI 記号を散布したのと比べると、同じプロンプトに対する応答の温度が明らかに低い。

3 プロンプトを横に並べると、Qwen-Image 2.0 の個性が引き算の誠実さだと言い切れる気がします。プロンプトに書かれたことを正確に描き、それ以上を置かない。背景には、テキストエンコーダとして据えられている Qwen 系の LLM が、文脈推測を積極的に膨らませない方向に振られている可能性があります。何にせよ結果として、頼んだことだけが返ってくるという、従来の画像 AI にはなかった種類の安心感が残ります。

ERNIE-Image-Turbo — 情報グラフィックの編集者

次は同じ 3 プロンプトを ERNIE-Image-Turbo に投げたもの。ここからの 3 枚は第 1 回にも掲載した画像の再掲になります。第 1 回では「読める日本語」に驚きを置き、SDXL base 1.0 の崩れる擬似グリフと並置して書ける/書けないの境目を強調しました。今回は同じ画像を別の視点から見直します。改めて眺めると、このモデルは読めるだけではなく情報階層そのものを組み立てて返してきているのが分かります。

まず壁ポスターのワークスペース。

プロンプトで頼んだのは「サムネイル 自動生成」の 1 行でした。返ってきたポスターには「サムネイル」「自動生成」「自動生成ツール」と日本語が 3 層に分けて置かれ、その下に英字サブコピー「Image Generation Tool」が添えられています。主題・副題・英字キャプションの 3 段階の情報階層が、頼んでいないのに整えられて入っている。Nano Banana 2 の自発サブコピーと似て非なるものです。Nano Banana 2 は「それらしい説明文」を足すのに対し、ERNIE は「ポスターというフォーマットが要求する情報構造」を補完してくる。

マンガ調パネル。

吹き出しの「実測!」に加えて、背後の GPU には「NVIDIA」「RTX」のロゴが再現されています。ちょっと多すぎるのと、コピーライト的な心配はあります。また、腕が3本あったり、画面からスマホが「伸びて」いたりと不安を煽る要素が多い。線画は ChatGPT 系の AI マンガテンプレに近い雰囲気ですが、注目したいのはロゴという読めて意味のある記号をきちんと置いてくる挙動のほうです。ここでも「ベンチマークするマンガ」というフォーマットに必要な情報がひとつずつ組み上がっている。

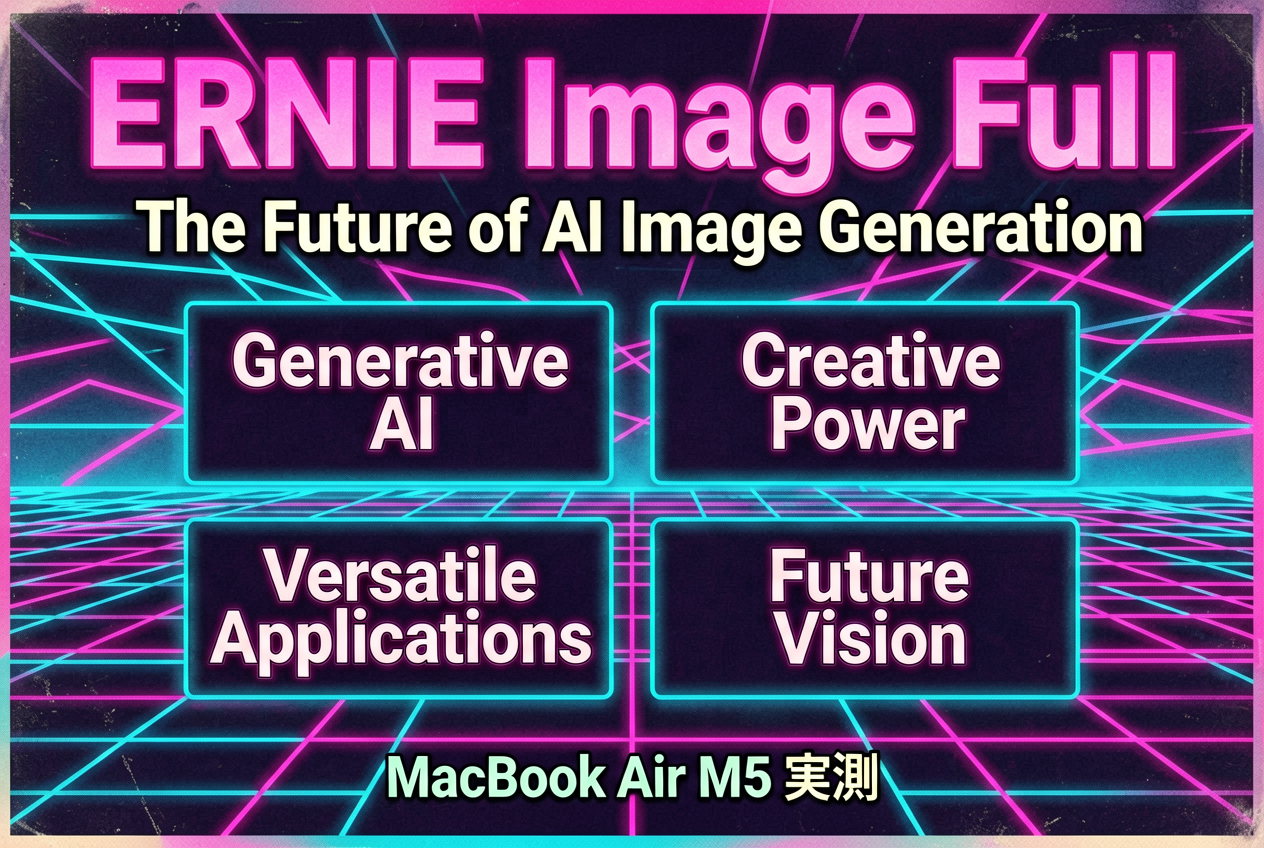

80s ポスター。

ここが一番明確でした。プロンプトには「80s ネオンポスター」としか書いていないのに、返ってきたのは 4 パネルに分割された情報グラフィックです。各パネルに「Generative AI / Creative Power / Versatile Applications / Future Vision」のラベル、上部に主題、下部に英字の副題「The Future of AI Image Generation」、右上に「MacBook Air M5 実測」の日本語副題。情報密度は 4 モデルの中で最も高く、ポスターというよりプレゼン資料の 1 ページのような構成に寄っています。

3 枚を並べると、ERNIE-Image-Turbo は情報グラフィックの編集者だと読めます。文字入りの画像を作るときに、「文字はこの階層で、副題は英字で、ロゴは背景に」というポスター/プレゼン資料の発想を先回りで持ち込んでくる。テキストエンコーダに Ministral-3B を据え、Baidu の学習データで「文字入り画像とはこういうもの」という強い前提を内側に持っていることの現れだと感じます。Nano Banana 2 が構図の範囲で気を利かせ、GPT-Image 2 が物語の範囲で作り込むのに対し、ERNIE は情報構造の範囲で編集する。方向が一段階ずれている。

ここで公平に一つ添えておきます。04 の画像をよく見るとエンジニアの右腕が 2 本あり、机の上の GPU と配線も遠近法が合いません。この解剖学や空間構造の破綻は、今回扱っている Turbo (8 step 蒸留版) で観測されやすい傾向です。ERNIE は negative_prompt を受け取らない設計なので、SDXL 系でよく使う「extra limbs, bad anatomy」のような抑制プロンプトが通りません。回避するなら (a) 同一プロンプトを seed 違いで数回回して良いものを拾う、(b) 50 step の Full 版に切り替えて時間を 6 倍払う、(c) プロンプトに “with two hands only, anatomically correct” のような正の表現を足す、といった実務的な逃げ方になります。情報構造を先回りで整えてくれる編集者は、細部の整合性のチェックは抜けがちな編集者でもある——この二面性は第 5 回の実装編で正面から扱います。

オープンであること、の意味

ここで 2 モデルの個性から一歩引いて、オープンであること自体の意味に触れておきたいです。

Qwen-Image 2.0 と ERNIE-Image-Turbo の「オープン」は、厳密には同じ種類のものではありません。Qwen-Image 2.0 は利用条件が Alibaba のプラットフォーム運用規約に沿っていて、商用利用に関しては確認が必要な領域が残ります。一方 ERNIE-Image-Turbo は Apache 2.0 ライセンスで公開されていて、重みを手元にダウンロードし、商用のアイキャッチ自動生成にそのまま組み込むことが認められています。ローカルで動くことと、商用利用が開かれていることは別の層の話で、この両方が揃ったときに初めて、「所有できる創作ツール」という概念が成立します。

所有できる、ということが何を変えるか。創作の工程を自分の敷地の中に閉じ込められるのは、個人の自動化にとって想像以上に大きな自由です。API がある日ポリシーを変えても、重みが手元にある限り昨日と同じ挙動が返ってきます。

ただし、自由は面倒も連れてきます。GPU か Apple Silicon の統一メモリが要り、ComfyUI のワークフローを組み、モデルのバージョンを追いかけないといけません。クラウドに払っていたコストは、別の形で手元の運用コストに置き換わる。それでも敷地に置きたいと思えるかどうかは、モデルを「使う」以上のところ——自分の工程の一部として育てたいという感覚があるかどうか——に依っている気がします。

4 社で 4 つの世界観が出揃った

第 2 回と今回で、4 モデルの個性が一度に並びました。整理すると、こう読めます。

- Google (Nano Banana 2): 構図と装飾の範囲で気を利かす、整理する編集者

- OpenAI (GPT-Image 2 Thinking): 文脈を仮構して世界を作り込む、過剰に奉仕する制作者

- Alibaba (Qwen-Image 2.0): プロンプトに忠実、引き算の誠実さを守るモデル

- Baidu (ERNIE-Image-Turbo): 文字入り画像の情報階層を補完する、情報グラフィックの編集者

2026 年春の時点で、日本語を描ける 4 モデルは偶然にもそれぞれ違う方向に振れて並びました。「文字が読める」という共通点の下で、4 社が選んだ方向性がこれだけ違うことは、個人の側にとってはむしろ福音です。使う側が用途に合わせて選び分けられる余地が、それだけ豊かになっている。

今回の 2 モデルに絞って思想部としての観点を置くなら、手元に置けるツールと、置けないツールでは、創作と自己表現の距離感が変わるという一点です。クラウドのクローズドモデルは「外注」に近い関係で、手元のオープンモデルは「相棒」に近い関係になります。どちらが上ということではなく、創作のどの層にどちらを連れてくるかの選択だと思います。便利さを取りに行くのか、工程そのものを自分の敷地に抱え込むのか——この二択は、思想部が長く掘りたい主題につながっていきそうです。

次回への布石

4 世界観が出揃いました。次回は、これを横並びの評価軸に戻します。共通プロンプト 6 種と 4 モデル、加えて既存の RealVisXL + Pillow 合成パイプラインまで並べて、アイキャッチという具体的な用途で、どのモデルを / どの場面で採用するかという判断の手前まで持っていく予定です。

4 つの世界観が同居する時代に、わたしたちは用途ごとに何を相棒として選ぶのか——この問いに答える準備を整える回になります。